近日,我校计算机科学与技术学院朱付保教授团队联合密歇根理工大学应用计算系周卫华教授在国际知名期刊《Information Fusion》(中科院一区TOP期刊,IF=18.6)上发表了题为“Model-level attention and batch-instance style normalization for federated learning on medical image segmentation”(用于联邦学习医学图像分割的模型级注意力和风格归一化)的研究论文。

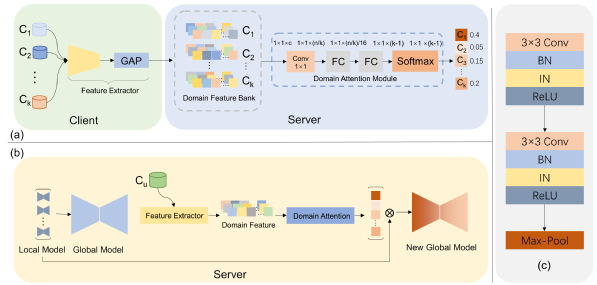

联邦学习为跨中心医疗协作和数据共享提供了一种有效的隐私保护机制。在多站点医学图像分割中,联邦学习允许每个医疗站点作为客户端,形成自己的数据域,从而可能提高模型在已知域上的性能。然而,由于不同域中数据的非独立同分布特性,导致模型在不可见域的泛化(域泛化)性能下降。为了应对这一挑战,朱付保教授团队提出了轻量级的模型级注意力(MLA)和风格归一化模块(BIN)来解决联邦学习中的域泛化问题。MLA模块将未知域表示为已知域模型的线性组合。MLA不需要访问原始数据,而是在已知域的数据特征中充分探索学习,从而识别域间数据特征的差异,使全局模型从可见的域泛化到未知域。在BIN中,结合批归一化和实例归一化特点运行在分割网络的浅层以进行风格归一化。BIN与分割骨干网络结合,在无需访问其他中心数据的情况下,确保了域内特征的有效学习和域间图像风格归一化。实验结果表明,所提方法优于目前最先进的方法。本方法为联邦学习医学图像分割模型的实际部署提供了新思路。

该论文是以郑州轻工业大学为第一署名单位完成,朱付保教授为第一作者,硕士研究生田延晖为共同第一作者,姚妮(高级实验师)和周卫华(教授)为通信作者。

《Information Fusion》创刊于2000年,是一本由ELSEVIER出版的理论方法学术刊物,该刊是国际一流期刊,发文范围涵盖计算机人工智能等领域。此刊已入选SCI、SCIE来源期刊,是中科院分区1区TOP期刊,2023年影响因子18.6。

此项研究成果得到了国家自然科学基金、河南省科技攻关项目的支持。

论文链接:https://doi.org/10.1016/j.inffus.2024.102348